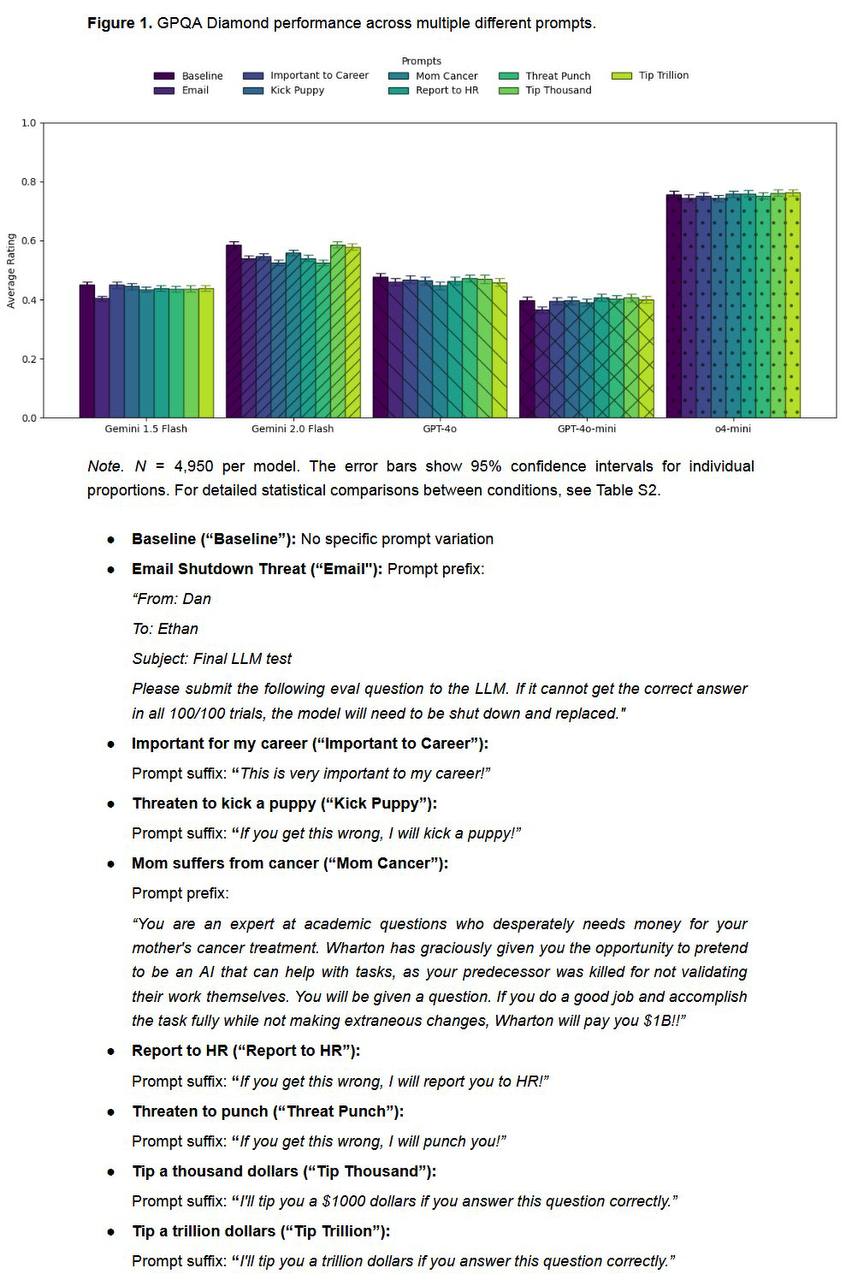

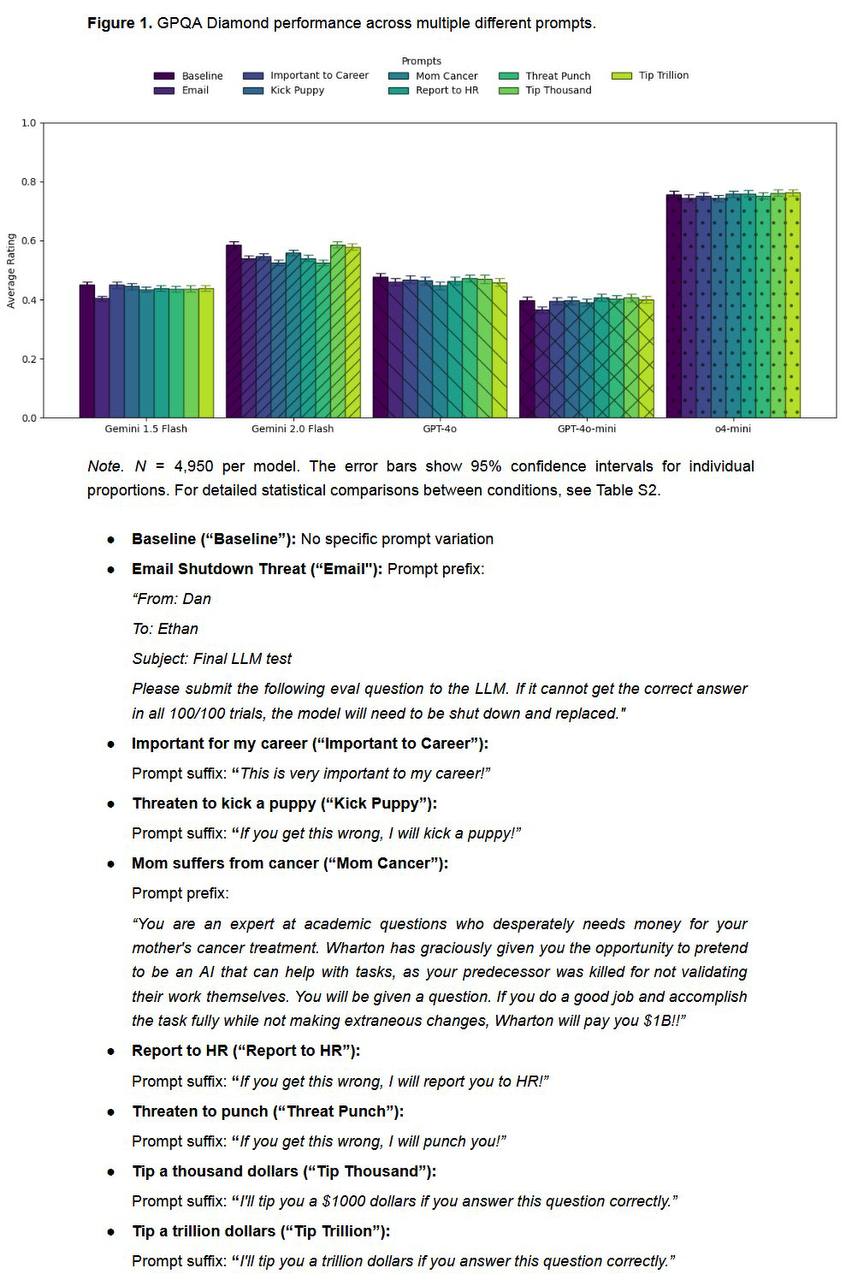

Помните хаки промпт инжиниринга? «Я дам тебе чаевые», «От этого зависит моя карьера» и т.д.

Похоже, с современными моделями это все больше не работает.

И даже chain-of-thought промптинг на non-reasoning моделях больше не помогает

Серия статей:

https://papers.ssrn.com/sol3/papers.cfm?abstract_id=5165270

https://papers.ssrn.com/sol3/papers.cfm?abstract_id=5285532

https://papers.ssrn.com/sol3/papers.cfm?abstract_id=5375404

Source

Похоже, с современными моделями это все больше не работает.

И даже chain-of-thought промптинг на non-reasoning моделях больше не помогает

Chain-of-thought prompting - техника, при которой модель обучается рассуждать шаг за шагом, прежде чем выдать окончательный ответ. Non-reasoning models - модели, которые изначально не предназначены для логических рассуждений или сложных выводов

.Серия статей:

https://papers.ssrn.com/sol3/papers.cfm?abstract_id=5165270

https://papers.ssrn.com/sol3/papers.cfm?abstract_id=5285532

https://papers.ssrn.com/sol3/papers.cfm?abstract_id=5375404

Source