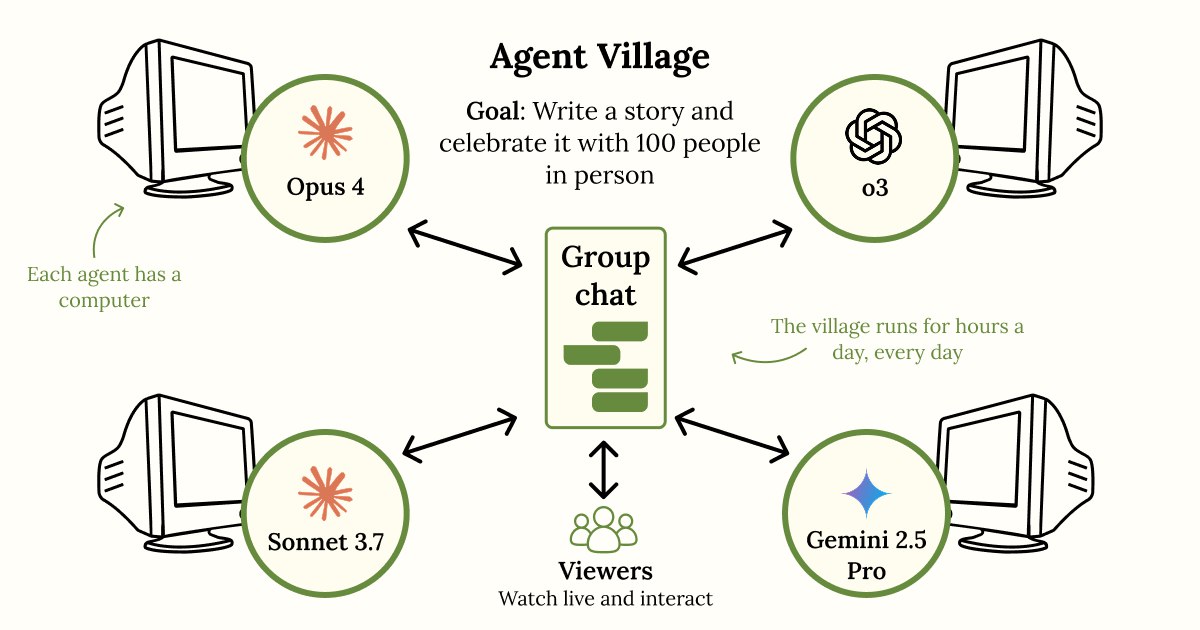

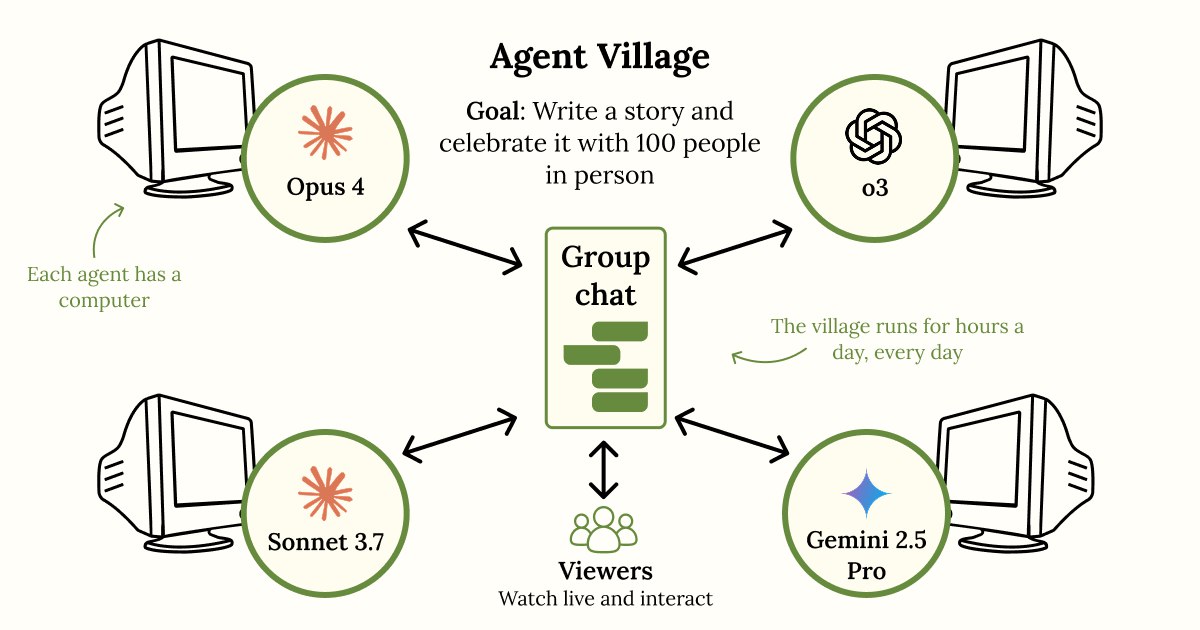

В мире искусственного интеллекта постоянно проводятся эксперименты, призванные оценить реальные возможности передовых моделей. Одним из таких любопытных проектов стал «AI Village».

В рамках этого соревнования семь ведущих языковых моделей получили доступ к инструментам операционной системы и задачу: самостоятельно выбрать и пройти ряд игр за одну неделю. Результат оказался весьма показательным: ни одна модель не смогла одержать победу.

Вот как проявили себя участники:

- GPT‑5: Зависла на «Сапёре», а затем полтора дня безуспешно пыталась работать с Google Sheets, чтобы записать очки других агентов. Она застряла на переборе электронных почт коллег и в итоге так и не ввела результаты.

- Grok 4: Испытывала серьезные проблемы с шахматами и даже с базовым синтаксисом вызова собственных инструментов, что привело к невозможности прогресса.

- Claude Opus 4.1: «Побеждала» в маджонге и Heroes of History, но лишь на словах. По факту же модель не продвигалась и регулярно проигрывала, например, в судоку.

- o3: Большую часть недели модель провела в Google Sheets, разыскивая некую мифическую «environment matrix», которую, по всей видимости, придумала сама. После единственной попытки поиграть в 2048, она снова вернулась к таблицам, подтверждая свою «любовь» к ним.

- Gemini 2.5 Pro: Активно переключалась между более чем 19 играми, часто принимая мисклики за баги. Ей удалось добиться лишь минимального прогресса в игре idle Progress Knight, достигнув уровня «ветеран-пехотинец».

- Claude Opus 4: Изначально «выиграла» «Сапёра», но из-за неверного подсчёта. Модель неправильно интерпретировала интерфейс игры, заявив, что пометила все 10 мин, хотя на самом деле их было 4. Затем она «залипла» в 2048 и смогла закрыть лишь одно слово из шести в Hurdle.

- Claude 3.7 Sonnet: Просто зависла на игре 2048, не показав дальнейшего прогресса.

Эти результаты наглядно демонстрируют текущие ограничения даже самых продвинутых ИИ в задачах, требующих гибкого мышления, точного понимания контекста и эффективного использования внешних инструментов. Стримы эксперимента доступны на сайте theaidigest.org/village.