Недавно стало известно об оптимизации производительности вычислений FP8

'FP8' или 'Float Point 8' — это формат чисел с плавающей запятой, использующий 8 бит для хранения данных. Он разработан для ускорения высокопроизводительных вычислений, таких как машинное обучение, за счет снижения точности и уменьшения объема памяти.

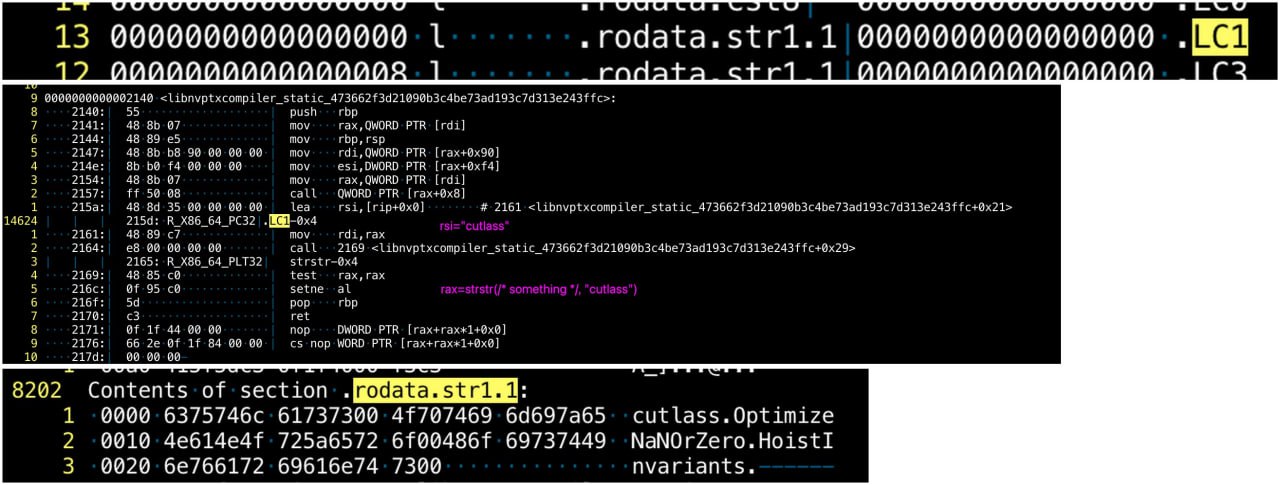

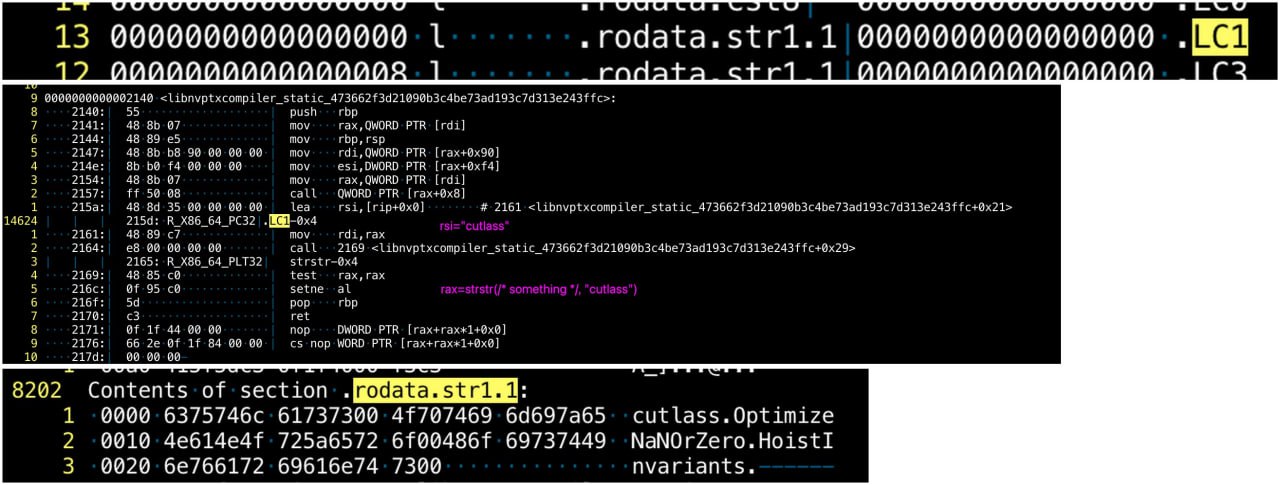

на архитектурах NVIDIA Blackwell и Hopper. Отмечается, что производительность, достигающая 150 Терафлопс (Tflops), значительно увеличивается при использовании ядер (kernel), содержащих в своем названии "cutlass". Это указывает на целенаправленные улучшения, ориентированные на конкретные библиотеки и методы оптимизации. Помимо "cutlass", были применены и другие значительные оптимизации, что в совокупности приводит к существенному приросту скорости обработки данных.